LOS VIDEOS PORNOGRÁFICOS FALSOS SE UTILIZAN COMO ARMAS PARA ACOSAR Y HUMILLAR A LAS MUJERES: "TODO EL MUNDO ES UN OBJETIVO POTENCIAL"

Articulo original The Washington Post

Los

creadores de 'Deepfake' están haciendo videos inquietantemente realistas

generados por computadora con fotos tomadas de la Web, utilizando una nueva

tecnología para poner caras de mujeres en los cuerpos de las estrellas del

porno con el propósito de chantajear y/o desacreditar a las mujeres comunes con

lo cual se logra un profundo daño.

El video

mostraba a la mujer con una blusa rosa con hombros descubiertos, sentada en una

cama, con una sonrisa convincente.

Era su

rostro. Pero había sido injertado a la perfección, sin su conocimiento o

consentimiento, en el cuerpo de otra persona: una joven actriz porno que apenas

comenzaba a desnudarse para el comienzo de una escena de sexo gráfico. Una

multitud de usuarios desconocidos lo había estado pasando en línea.

Sintió

náuseas y mortificación: ¿Y si sus compañeros de trabajo lo vieran? ¿Su

familia, sus amigos? ¿Cambiaría lo que pensaban de ella? ¿Creerían

que era falso?

“Me siento

violada, este tipo de violación repugnante”, dijo la mujer, que tiene unos 40

años y habló bajo condición de anonimato porque le preocupaba que el video

pudiera dañar su matrimonio o su carrera. “Es este sentimiento extraño,

como si quisieras arrancar todo de Internet. Pero sabes que no puedes.

Hace mucho

tiempo, la aerografía y Photoshop abrieron las fotos a una fácil

manipulación. Ahora, los videos se están volviendo igual de vulnerables a

las falsificaciones que parecen engañosamente reales. Sobrealimentados por

un software de inteligencia artificial potente y ampliamente disponible

desarrollado por Google, estos videos realistas "deepfake" se han

multiplicado rápidamente en Internet, desdibujando la línea entre la verdad y

la mentira.

Pero los

videos también se han utilizado como armas de manera desproporcionada contra

las mujeres, lo que representa un medio nuevo y degradante de humillación,

acoso y abuso. Las falsificaciones se detallan explícitamente, se publican

en sitios populares de pornografía y son cada vez más difíciles de

detectar. Y aunque su legalidad no ha sido probada en los tribunales, los

expertos dicen que pueden estar protegidos por la Primera Enmienda, aunque

también podrían calificar como difamación, robo de identidad o fraude.

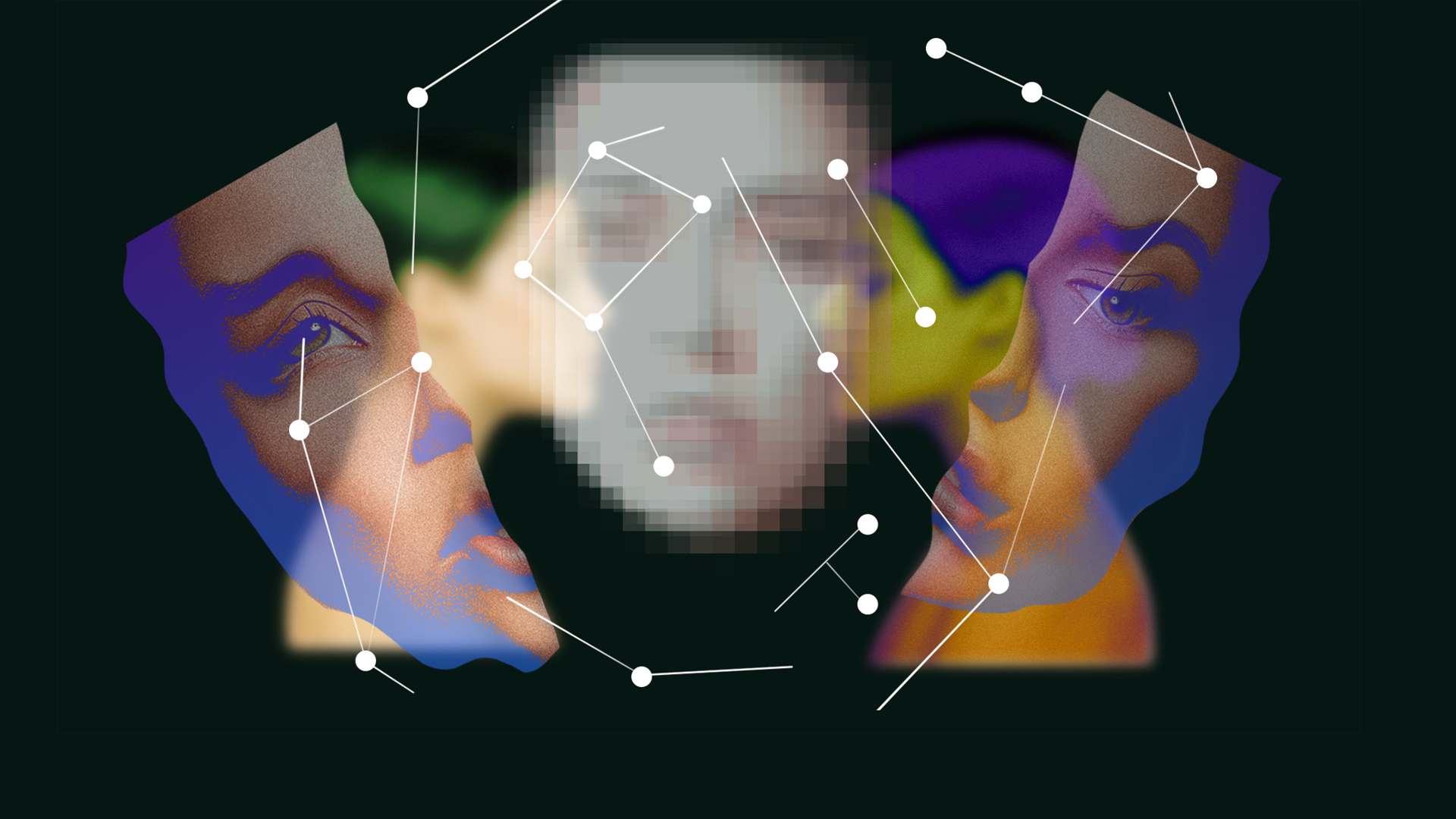

Deepfakes:

cómo se está utilizando una nueva tecnología para poner rostros de mujeres en

los cuerpos de las estrellas porno

Los videos

generados por IA que muestran la cara de una persona en el cuerpo de otra se

llaman "deepfakes". Cada vez son más fáciles de fabricar y usar

como armas contra las mujeres. (Vídeo: Drew Harwell, Jhaan Elker/The

Washington Post)

Se han hecho

falsificaciones inquietantemente realistas con los rostros de celebridades y

mujeres que no viven en el centro de atención, y la actriz Scarlett Johansson

le dijo a The Washington Post que le preocupa que "es solo cuestión de

tiempo antes de que una persona sea atacada" por una falsificación

espeluznante.

Johansson se

ha superpuesto en docenas de escenas gráficas de sexo durante el último año que

han circulado por la web: un video, descrito falsamente como material real

"filtrado", se ha visto en un importante sitio pornográfico más de

1,5 millones de veces. Dijo que le preocupa que ya sea demasiado tarde

para que las mujeres y los niños se protejan contra el "abismo

virtualmente sin ley (en línea)".

“Nada puede

impedir que alguien corte y pegue mi imagen o la de otra persona en un cuerpo

diferente y haga que se vea tan inquietantemente realista como se desea”,

dijo. “El hecho es que tratar de protegerse de Internet y su depravación

es básicamente una causa perdida... Internet es un gran agujero de gusano

de oscuridad que se come a sí mismo”.

En

septiembre, Google agregó "imágenes pornográficas sintéticas

involuntarias" a su lista de prohibición, lo que permite que cualquier

persona solicite al motor de búsqueda que bloquee los resultados que los

representan falsamente como "desnudos o en una situación sexualmente

explícita". Pero no hay una solución fácil para su creación y

difusión.

Un número

cada vez mayor de deepfakes se dirigen a mujeres alejadas del ojo público, con

usuarios anónimos en foros de discusión de deepfakes y chats privados que las

llaman compañeras de trabajo, compañeras de clase y amigas. Varios

usuarios que hacen videos a pedido dijeron que incluso hay una tarifa vigente:

alrededor de $20 por falsificación.

El

solicitante del video con el rostro de la mujer sobre el cuerpo con la blusa

rosa con hombros descubiertos había incluido 491 fotos de su rostro, muchas

tomadas de su cuenta de Facebook, y les dijo a otros miembros del sitio

deepfake que estaba "dispuesto a paga por un buen trabajo” Más tarde,

un reportero del Washington Post la encontró al pasar esos retratos a través de

una herramienta en línea conocida como búsqueda de imágenes inversas que puede

ubicar dónde se compartió originalmente una foto.

Después de

la solicitud, un equipo de autodenominados "creadores" tardó dos días

en realizar la entrega. Una audiencia en línea sin rostro celebró el

esfuerzo. “¡Buen comienzo!” escribió el solicitante.

“Es como un

asalto: la sensación de poder, el control”, dijo Adam Dodge, director legal de

Laura's House, un refugio para víctimas de violencia doméstica en

California. Dodge organizó una sesión de capacitación el mes pasado para

detectives y ayudantes del alguacil sobre cómo una pareja o cónyuge abusivo

podría usar deepfakes. “Con la capacidad de fabricar pornografía, todo el

mundo es un objetivo potencial”, dijo Dodge.

Cómo

los oponentes de la pornografía falsa están contraatacando

Los videos

han servido durante décadas como punto de referencia para la autenticidad,

ofreciendo una clara distinción de las fotos que podrían distorsionarse

fácilmente. El video falso, para todos, excepto para los artistas de alto

nivel y los estudios de cine, siempre ha sido técnicamente demasiado complicado

para hacerlo bien.

Pero los

avances recientes en la tecnología de aprendizaje automático, empleados por

creadores que compiten para refinar y perfeccionar sus falsificaciones, han

hecho que la creación de videos falsos sea más accesible que nunca. Todo

lo que se necesita para hacer una imitación persuasiva en cuestión de horas es

una computadora y una sólida colección de fotos, como las que millones de

personas publican en las redes sociales todos los días.

El resultado

es una nueva forma temible para que los extraños sin rostro inflijan vergüenza,

angustia o vergüenza. “Si fueras el peor misógino del mundo”, dijo Mary

Anne Franks, profesora de derecho de la Universidad de Miami y presidenta de

Cyber Civil Rights Initiative, “esta tecnología te permitiría lograr lo que

quisieras”.

Los hombres

se insertan en los videos casi en su totalidad como una broma: una imitación

popular muestra la cara del actor Nicolas Cage superpuesta a la del presidente

Trump. Pero los videos falsos de mujeres son predominantemente

pornográficos y exponen cómo la cosificación sexual de las mujeres está siendo

envalentonada por el mismo estilo de tecnología de inteligencia artificial que

podría sustentar el futuro de la Web.

La crítica

de los medios Anita Sarkeesian, que ha sido atacada en línea por sus críticas

feministas a la cultura pop y los videojuegos, fue insertada en un video porno

duro este año que ha sido visto más de 30,000 veces en el sitio de videos para

adultos Pornhub.

En los foros

de deepfake, los publicadores anónimos dijeron que estaban emocionados de

confrontarla con el video en sus cuentas de Twitter y correo electrónico, y

compartieron su información de contacto y sugerencias sobre cómo podían

asegurarse de que el video fuera fácilmente accesible e imposible de eliminar.

Un usuario

en el sitio de redes sociales Voat, que dice "Está bien ser blanco",

escribió: "Ahora ESTE es el deepfake que necesitamos y merecemos, aunque

solo sea por el principal". Otro usuario, “Hypercyberpastelgoth”,

escribió: “Ella nos atacó primero… Ella solo tuvo que abrir su boca

zalamera”.

Sarkeesian

dijo que las falsificaciones profundas eran una prueba más de "lo terrible

y horrible que es ser mujer en Internet, donde están todos estos hombres que se

sienten con derecho a los cuerpos de las mujeres".

“Para las

personas que no tienen un perfil alto, o que no tienen ningún perfil, esto

puede perjudicar sus perspectivas laborales, sus relaciones interpersonales, su

reputación, su salud mental”, dijo Sarkeesian. “Se usa como arma para

silenciar a las mujeres, degradar a las mujeres, mostrar poder sobre las

mujeres, reducirnos a objetos sexuales. Esto no es solo una cosa de

diversión y juegos. Esto puede destruir vidas” ' Más vulnerables '

El enfoque

de IA que generó los deepfakes comenzó con una idea simple: dos grupos opuestos

de algoritmos de aprendizaje profundo crean, refinan y recrean un resultado

cada vez más sofisticado. Un equipo dirigido por Ian Goodfellow, ahora

científico investigador de Google, presentó la idea en 2014

comparándola con el duelo entre los falsificadores y la policía, con ambas

partes impulsadas "a mejorar sus métodos hasta que las falsificaciones

sean indistinguibles".

El sistema

automatizó la tediosa y lenta tarea de hacer un video fotorrealista de

intercambio de caras: encontrar expresiones faciales coincidentes,

reemplazarlas sin problemas y repetir la tarea 60 veces por

segundo. Muchas de las herramientas de falsificación profunda, creadas en

la biblioteca de inteligencia artificial de Google, están disponibles

públicamente y son de uso gratuito.

El año

pasado, un creador anónimo que usaba el nombre en línea "deepfakes"

comenzó a usar el software para crear y publicar videos porno de actrices como

Gal Gadot en las que se cambiaban las caras en el gigante del foro de discusión

Reddit, ganando una gran atención e inspirando una ola de imitadores.

Anuncio

publicitario

Los videos

varían ampliamente en calidad, y muchos tienen fallas o son contras

obvios. Pero los creadores de deepfakes dicen que la tecnología está

mejorando rápidamente y no ven límites a los que pueden suplantar.

Si bien el

proceso de deepfake exige algunos conocimientos técnicos, en los últimos meses

una comunidad anónima de creadores en línea ha eliminado muchos de los obstáculos

para los principiantes interesados, elaborando guías prácticas, ofreciendo

sugerencias y consejos para la resolución de problemas, y cumpliendo con las

solicitudes de pornografía falsa en su propio.

Para

simplificar la tarea, los creadores de deepfakes a menudo compilan grandes

paquetes de imágenes faciales, llamadas "facesets", y videos de

escenas de sexo de mujeres a las que llaman "cuerpos de

donantes". Algunos creadores usan software para extraer

automáticamente el rostro de una mujer de sus videos y publicaciones en las

redes sociales. Otros han experimentado con software de clonación de voz

para generar audio potencialmente convincente.

No todos los

videos falsos dirigidos a mujeres se basan en la pornografía para impactar o

puntos políticos. Esta primavera, un video manipulado mostró a la

sobreviviente del tiroteo en la escuela de Parkland, Emma González, destrozando

la Constitución. Los activistas conservadores compartieron el video como

supuesta prueba de su traición antiestadounidense; en realidad, el video

la mostraba rompiendo blancos de papel de un campo de tiro.

Pero el uso

de deepfakes en la pornografía se ha disparado. Un creador en el foro de

discusión 8chan hizo un deepfake explícito de cuatro minutos con el rostro de

un joven bloguero alemán que publica videos sobre maquillaje; Se habían

extraído miles de imágenes de su rostro de un tutorial de cabello que había

grabado en 2014.

Reddit y

Pornhub prohibieron los videos este año, pero rápidamente surgieron nuevas

alternativas para reemplazarlos. Los principales foros de discusión en

línea como 8chan y Voat, cuyos representantes no respondieron a las solicitudes

de comentarios, operan sus propios foros de falsificación profunda, pero los videos

también se pueden encontrar en sitios independientes dedicados a su difusión.

El creador

de un sitio de deepfakes, que habló bajo condición de anonimato por temor a ser

juzgado, dijo que su sitio de 10 meses recibe más de 20.000 espectadores únicos

todos los días y depende de la publicidad para obtener una modesta

ganancia. Las celebridades se encuentran entre los mayores atractivos para

el tráfico, dijo, y agregó que cree que su fama, y la gran cantidad de

imágenes públicas disponibles, los ha convertido en un juego justo.

Las únicas

reglas en el sitio, que alberga un foro activo para solicitudes personales, son

que los objetivos deben tener 18 años o más y no ser representados “de manera

negativa”, incluso en escenas de violencia gráfica o violación. Agregó que

el sitio "solo está semi-moderado" y depende de que sus usuarios se

vigilen a sí mismos.

Un creador

de deepfakes que usa el nombre "Cerciusx", que dijo que es un

estadounidense de 26 años y habló bajo condición de anonimato porque teme la

reacción del público, dijo que rechaza las solicitudes de personas que no son

celebridades porque pueden propagarse con demasiada facilidad. un campus

escolar o lugar de trabajo y dejar una cicatriz en la vida de una persona.

Sin embargo,

muchos creadores cumplen con tales solicitudes para hacer que una mujer parezca

"más vulnerable" o dar vida a una fantasía oscura. “La mayoría

de los chicos nunca consiguen a la chica de sus sueños”, dijo. “Es por eso

que prosperan los deepfakes”.

En abril,

Rana Ayyub, una periodista de investigación en India, fue alertada por una

fuente sobre un video sexual falso que mostraba su rostro en el cuerpo de una

mujer joven. El video se difundió por miles en Facebook, Twitter y

WhatsApp, a veces adjunto a amenazas de violación o junto a la dirección de su

casa.

Ayyub, de 34

años, dijo que ha sufrido acoso en línea durante años. Pero el deepfake se

sintió diferente: excepcionalmente visceral, invasivo y cruel. Vomitó

cuando lo vio, lloró durante días y corrió al hospital, abrumada por la

ansiedad. En una estación de policía, dijo, los oficiales se negaron a

presentar un informe y pudo verlos sonreír mientras miraban la falsificación.

“Se las

arregló para romperme. Fue abrumador. Todo en lo que podía pensar era

en mi carácter: ¿Es esto lo que la gente pensará de mí? ella

dijo. “Esto es mucho más intimidante que una amenaza física. Esto

tiene un impacto duradero en su mente. Y no hay nada que pueda evitar que

me vuelva a pasar”.

Las víctimas

de las falsificaciones profundas tienen pocas herramientas para

defenderse. Los expertos legales dicen que los deepfakes a menudo son

demasiado imposibles de rastrear para investigarlos y existen en un área gris

legal: creados a partir de fotos públicas, son en realidad nuevas creaciones,

lo que significa que podrían protegerse como libertad de expresión.

Los

defensores de los derechos civiles están llevando a cabo maniobras legales no

probadas para tomar medidas enérgicas contra lo que llaman “pornografía no

consensuada”, utilizando estrategias similares empleadas contra el acoso en

línea, el acoso cibernético y la pornografía vengativa. Los abogados

dijeron que podían emplear leyes de acoso o difamación, o presentar órdenes de

restricción o avisos de eliminación en los casos en los que sabían lo

suficiente sobre la identidad o las tácticas de los creadores de

deepfake. En 2016, cuando un hombre de California fue acusado de

superponer a su exesposa en imágenes pornográficas en línea, los fiscales

probaron una táctica poco convencional y lo acusaron de 11 cargos de robo de

identidad.

Danielle

Citron, profesora de derecho de la Universidad de Maryland que ha estudiado

formas de combatir el abuso en línea, dice que el país necesita

desesperadamente un estatuto penal más completo que cubra lo que ella llama

"invasiones de la privacidad sexual y asesinatos de

carácter". “Necesitamos disuasivos reales”, dijo. “De lo

contrario, es solo un juego de golpear un topo”.

Los

representantes de Google dijeron que la compañía se toma en serio su

responsabilidad ética, pero que las restricciones en sus herramientas de IA

podrían terminar limitando a los desarrolladores a impulsar la tecnología de

manera positiva.

Pero Hany

Farid, un profesor de ciencias de la computación de Dartmouth College que se

especializa en examinar fotos y videos manipulados, dijo que Google y otros

gigantes tecnológicos deben “tomarse más en serio lo armada que puede ser esta

tecnología”.

“Si un

biólogo dijera, 'Aquí hay un virus realmente genial; vamos a ver qué pasa

cuando el público lo tenga en sus manos', eso no sería aceptable. Y, sin

embargo, es lo que hace Silicon Valley todo el tiempo”, dijo. “Es

indicativo de una industria muy inmadura. Tenemos que comprender el daño y

reducir la velocidad en la forma en que implementamos una tecnología como

esta”.

Las pocas

soluciones propuestas hasta el momento pueden lograr poco para las mujeres que

han sido atacadas, incluida la mujer cuyas imágenes fueron robadas por el

solicitante “dispuesto a pagar por un buen trabajo”. Después de ver el

video, dijo que estaba furiosa y con energía para emprender acciones legales.

Pero sus

esfuerzos por encontrar al solicitante no han ido a ninguna parte. No

respondió a los mensajes, y desde entonces sus publicaciones han sido

eliminadas, su cuenta desapareció sin dejar rastro. Todo lo que quedó fue

el deepfake. Ha sido visto más de 400 veces.

No hay comentarios:

Publicar un comentario